Imagem: O Show de Truman (1998)

Por que isso é importante?

Porque, na prática, isso afeta o modo como você pesquisa, escreve, decide e consome informação todos os dias.

O artigo mostra que a IA está reorganizando percepção, trabalho e decisão em escala, enquanto a sociedade ainda entende pouco sobre a coleta de dados, a falta de transparência das BigTechs e a concentração de poder por trás desse “avanço”.

A discussão pública sobre inteligência artificial continua atrasada em relação ao que já está acontecendo na prática. Enquanto a maior parte das pessoas ainda enxerga a IA como ferramenta de produtividade, assistente de texto ou novidade impressionante, a transformação real ocorre em uma camada muito mais profunda: coleta massiva de dados, integração com sistemas reais, automação de processos mentais, mediação crescente da linguagem e concentração de poder em infraestruturas privadas. O problema já não está apenas no que essas tecnologias fazem diante do usuário, mas no modo como reorganizam silenciosamente a relação entre pessoas, informação, comportamento, decisão e realidade.

Esse avanço não ocorre em um ambiente de plena consciência coletiva. Ao contrário, ele se apoia justamente em uma condição de vulnerabilidade social e informacional. Milhões de pessoas entregam rotinas, preferências, comandos, dúvidas, padrões de linguagem e modos de pensar a sistemas que aprendem com esse fluxo contínuo, quase sempre sem compreensão real sobre a escala da coleta, os limites da transparência ou os interesses que atravessam essa operação. A doação de dados não acontece apenas quando alguém publica algo ou aceita um termo; ela acontece também na forma como se pergunta, delega, corrige, confia e transfere etapas mentais para interfaces cada vez mais naturais.

É por isso que o debate sobre IA precisa sair do campo promocional e entrar no campo estrutural. Não basta perguntar se a tecnologia é útil, inevitável ou perigosa. É preciso observar como ela opera, quem controla sua infraestrutura, quais capacidades permanecem fora do alcance público, como a visibilidade é administrada e por que a transparência disponível continua muito abaixo do poder que já está em jogo. A questão central não é apenas o avanço da máquina, mas a vulnerabilidade humana diante de sistemas que filtram linguagem, percepção e decisão em escala crescente.

Dados, coleta e vulnerabilidade: o que estamos entregando

Grande parte da população ainda imagina que a relação com a inteligência artificial começa e termina na superfície da interface. A impressão mais comum é a de que o usuário apenas faz uma pergunta, recebe uma resposta e segue adiante. Mas essa leitura já não dá conta da realidade. O avanço da IA depende de muito mais do que modelos sofisticados; ele depende de fluxo contínuo de linguagem, comportamento, correção humana, preferências reveladas, padrões de uso e integração com ambientes digitais cada vez mais amplos. Em outras palavras, a sociedade não está apenas utilizando essas ferramentas. Está alimentando estruturas que aprendem com a forma como pensamos, pedimos, hesitamos, confiamos e delegamos.

Esse ponto é decisivo porque desloca o debate de “dados” como algo abstrato para “dados” como expressão concreta de vulnerabilidade. Não se trata apenas de textos publicados, históricos de navegação ou conteúdos públicos capturados em escala. Trata-se também de telemetria, logs de uso, interações reiteradas, ajustes de comportamento, padrões de correção e sinais cognitivos deixados em cada comando. Sempre que alguém usa a IA para organizar ideias, pedir aconselhamento, estruturar estratégia, revisar um texto, resumir um problema ou decidir um caminho, deixa rastros que ultrapassam o conteúdo explícito da pergunta. O sistema não aprende só com o que é dito. Aprende com a maneira como aquilo é formulado, ajustado, aceito ou recusado.

📌 Não estamos entregando apenas informação; estamos entregando comportamento. Isso inclui ritmo mental, padrões de delegação, critérios implícitos de confiança, linguagem cotidiana e modos recorrentes de tomada de decisão.

🔎 A vulnerabilidade aumenta quando a coleta se dissolve na conveniência. Quanto mais fluida, útil e natural parece a interface, menor tende a ser a percepção sobre o volume de sinais que está sendo incorporado ao ecossistema.

⚠️ A assimetria não está só na tecnologia, mas na consciência sobre ela. Enquanto milhões usam essas ferramentas como extensão cotidiana da vida digital, poucos compreendem a profundidade com que esse uso fortalece infraestruturas privadas de mediação e poder.

Por isso, o debate sobre dados precisa deixar de ser tratado como detalhe técnico ou preocupação lateral. O que está em curso é uma doação contínua de linguagem, intenção e comportamento para sistemas cuja transparência permanece parcial e cuja capacidade real não é plenamente visível para o público. Quanto mais essa entrega acontece sem consciência crítica, mais a vulnerabilidade deixa de ser exceção e passa a ser condição estrutural.

Conveniência, dependência e rebaixamento da consciência

A força da inteligência artificial não está apenas no que ela consegue fazer, mas na forma como ela se instala. Tecnologias anteriores exigiam aprendizado, adaptação e alguma resistência inicial. A IA, ao contrário, avança justamente porque reduz fricção. Ela escreve mais rápido, resume melhor, organiza tarefas, sugere caminhos, interpreta comandos vagos, corrige falhas e devolve respostas com aparência de coerência imediata. Essa fluidez cria a sensação de que se trata apenas de uma ferramenta eficiente, quando na prática ela começa a ocupar o espaço entre intenção e elaboração. O usuário já não precisa atravessar todo o processo de pensar, estruturar, testar e refinar. Em muitos casos, basta pedir.

É nesse ponto que a conveniência deixa de ser conforto e passa a ser mecanismo de dependência. Quanto mais natural se torna terceirizar etapas mentais, menos percebido se torna o deslocamento interno que acompanha essa prática. Aos poucos, atividades que antes exigiam esforço cognitivo direto passam a ser resolvidas por mediação algorítmica. Escrever, sintetizar, pesquisar, analisar, planejar, revisar, argumentar e até decidir rotas preliminares tornam-se ações parcialmente externalizadas. Isso não significa que a inteligência humana desapareça, mas significa que uma parte crescente do trabalho mental passa a ser organizada fora dela.

🧠 O problema não é apenas usar a IA, mas se acostumar a pensar através dela. Quando a mediação externa se torna padrão, a autonomia cognitiva deixa de ser exercida em sua forma plena e passa a operar sob assistência permanente.

📌 A dependência não nasce do colapso, mas da adaptação confortável. Não é preciso perder capacidade de uma vez para se tornar vulnerável; basta deixar de exercitar com regularidade funções que antes pertenciam ao processo interno de elaboração.

⚠️ O rebaixamento da consciência acontece quando a facilidade substitui a percepção crítica. Quanto mais a resposta pronta parece suficiente, menos espaço resta para investigação, confronto de fontes, dúvida produtiva e formulação própria.

O efeito mais profundo dessa dinâmica não é apenas profissional ou técnico. Ele é mental e cultural. Uma sociedade que se habitua a receber pensamento sintetizado, decisão assistida e linguagem pronta tende a perder intimidade com o processo que antecede a clareza. E quando isso acontece em escala, a conveniência deixa de ser apenas utilidade. Ela passa a ser arquitetura de condicionamento.

Programas fechados, risco real e capacidade privada

A parte mais sensível do avanço da inteligência artificial não está necessariamente nas ferramentas mais populares, mas nas camadas menos acessíveis em que capacidade, risco e poder operacional começam a se concentrar. Enquanto o público acompanha a superfície visível do setor por meio de assistentes, geradores de imagem e interfaces de produtividade, existe uma outra dimensão em curso: modelos avaliados para tarefas mais complexas, programas com acesso restrito, fluxos agentic, integrações com código, contextos de cibersegurança e estruturas institucionais que administram o que pode ser mostrado, por quem, e em que grau. É nessa zona que a distância entre percepção pública e capacidade real começa a se tornar mais relevante.

Esse cenário já não pode ser tratado apenas como hipótese abstrata. Iniciativas públicas e relatórios recentes mostram que os próprios laboratórios reconhecem mudanças de patamar. A Anthropic apresenta o Claude Code como uma ferramenta agentic de programação integrada a fluxo de desenvolvimento e automação técnica, enquanto o Claude Mythos Preview foi descrito em contexto restrito de segurança cibernética dentro do Project Glasswing, ligado a testes mais sensíveis de descoberta e exploração de vulnerabilidades. Ao mesmo tempo, o AI Security Institute (AISI), no Reino Unido, vem testando modelos de fronteira em áreas como cyber, autonomia e riscos severos. Isso não valida narrativas exageradas sobre uma IA onipotente capaz de fazer qualquer coisa sob um comando simples. O que valida é algo talvez mais grave: a existência de uma fronteira técnica mais avançada do que a maior parte do público acompanha em tempo real.

📌 Programas fechados não existem apenas para proteger tecnologia, mas para controlar acesso à visibilidade. Quando a exposição pública é seletiva, a percepção social sobre risco e capacidade também passa a ser administrada.

⚠️ O risco real não está só naquilo que é anunciado, mas no intervalo entre o que já é operacionalmente possível e o que o público ainda imagina ser apenas ficção ou exagero.

🔎 Capacidade privada e compreensão pública não avançam no mesmo ritmo. Essa diferença sustenta uma assimetria em que poucos testam, poucos avaliam e poucos conhecem a profundidade técnica do que já está sendo desenvolvido.

Por isso, discutir inteligência artificial com seriedade exige nomear programas, instituições e sistemas, sem cair em propaganda nem em fantasia. O ponto central não é inventar poderes absolutos para a máquina, mas reconhecer que a opacidade parcial ao redor dessas capacidades já é, por si só, um dado estrutural do problema.

Regulação, opacidade e a administração da visibilidade

À medida que a inteligência artificial avança, cresce também o esforço institucional para criar marcos de avaliação, gestão de risco e contenção. Mas é preciso olhar essa camada com precisão. Regulação não significa transparência plena, e publicação de frameworks não equivale a acesso real ao funcionamento profundo dos sistemas. O que existe hoje é um campo em disputa, no qual governos, laboratórios, organismos técnicos e grandes empresas tentam definir critérios mínimos para uma tecnologia que já se expandiu mais rápido do que sua supervisão pública. Nesse cenário, a regulação aparece menos como garantia de clareza e mais como tentativa de organizar limites em torno de estruturas que continuam amplamente assimétricas.

Nos últimos anos, alguns marcos se tornaram centrais nessa paisagem. O EU AI Act consolidou um modelo regulatório baseado em categorias de risco, enquanto o European AI Office passou a integrar a governança dessa implementação. Nos Estados Unidos, o NIST AI Risk Management Framework se tornou uma referência importante para gestão de risco, e organismos como a OCDE ajudaram a consolidar princípios para uma IA considerada confiável. Paralelamente, institutos como o AI Security Institute (AISI) passaram a testar modelos de fronteira em áreas críticas, tentando medir capacidades e cenários de dano. O problema é que tudo isso convive com um limite estrutural: as instituições observam, classificam e orientam, mas não controlam integralmente a visibilidade do que os laboratórios sabem, publicam ou restringem. É justamente aí que a administração da visibilidade se torna parte central da arquitetura de poder.

📌 Regular não é o mesmo que enxergar. A existência de normas, frameworks e escritórios especializados não elimina o fato de que boa parte da capacidade técnica continua sendo comunicada de forma parcial, seletiva e estratégica.

🔎 A visibilidade pública da IA é dosada. O que chega ao debate social costuma vir mediado por system cards, relatórios, comunicados e recortes institucionais que mostram fragmentos do cenário, não o quadro completo.

⚠️ A opacidade não desaparece com governança formal. Ela apenas muda de forma, passando a coexistir com mecanismos de supervisão que ainda operam atrás do ritmo da tecnologia.

Por isso, o desafio atual não é apenas criar regras, mas compreender que a própria transparência já se tornou um território disputado. Quem define o que pode ser visto, medido e divulgado também influencia a forma como a sociedade percebe risco, legitimidade e urgência.

Transparência, influência e disputa por soberania

O debate sobre inteligência artificial não pode mais ser reduzido a inovação, produtividade ou fascínio tecnológico. O que está em curso é uma reorganização profunda das relações entre linguagem, percepção, trabalho, informação e poder. Ao longo desse processo, a sociedade não apenas adota novas ferramentas, mas se adapta a uma infraestrutura crescente de mediação, na qual sistemas privados passam a participar da forma como se escreve, se pesquisa, se decide, se interpreta e se acessa o real. Quanto mais essa mediação se torna cotidiana, mais a influência deixa de parecer excepcional e passa a operar como ambiente.

É justamente por isso que a transparência se torna um ponto central. Não como promessa institucional, nem como valor abstrato, mas como critério mínimo para qualquer sociedade que não queira entregar percepção, comportamento e decisão a estruturas que permanecem amplamente assimétricas. Hoje, a maior parte das pessoas utiliza sistemas cada vez mais poderosos sem acesso proporcional ao que os alimenta, aos limites que os contêm, aos critérios que os modulam ou às capacidades que já operam fora do alcance público. Essa distância entre uso cotidiano e compreensão real é uma das formas mais decisivas de vulnerabilidade contemporânea.

📌 A questão não é apenas o que a IA faz, mas o que ela passa a organizar. Quando uma tecnologia filtra linguagem, prioriza respostas, sintetiza realidade e media rotinas, ela participa ativamente da produção de influência.

🔎 Transparência parcial não elimina assimetria. Divulgar fragmentos, relatórios e recortes controlados não significa tornar visível a totalidade da arquitetura que sustenta esses sistemas.

⚠️ Soberania, hoje, também é soberania cognitiva. Em um cenário mediado por IA, preservar autonomia não depende apenas de acesso tecnológico, mas da capacidade de reconhecer filtros, entender estruturas e recusar passividade diante da conveniência.

No centro desse debate não está apenas a máquina, mas o tipo de sociedade que se forma ao redor dela. Se a realidade passa a chegar cada vez mais filtrada, compreender quem organiza essa filtragem deixa de ser curiosidade intelectual e passa a ser necessidade histórica.

O que está em jogo quando a realidade começa a chegar filtrada

A inteligência artificial já não pode ser tratada apenas como inovação, tendência ou conveniência tecnológica. O que está em curso é uma reorganização silenciosa da forma como o mundo é acessado, interpretado e operacionalizado. Ao longo desse processo, linguagem, percepção, trabalho, decisão e comportamento deixam de circular apenas por mediações humanas e passam a depender, cada vez mais, de infraestruturas privadas que selecionam, sintetizam, priorizam e condicionam aquilo que chega até nós. O problema, portanto, não está apenas no avanço técnico da máquina, mas na assimetria estrutural entre quem opera esses sistemas e quem apenas vive sob sua influência. Essa linha já está muito bem construída no artigo, especialmente quando você conecta coleta, dependência, capacidade privada e administração da visibilidade.

O ponto mais sensível de tudo isso é que a vulnerabilidade contemporânea não nasce apenas da falta de acesso à tecnologia, mas da falta de consciência sobre como ela já reorganiza a experiência do real. A sociedade entrega linguagem, dados, comportamento, atenção e etapas inteiras da elaboração mental a sistemas cuja transparência permanece parcial, cuja capacidade pública não revela toda a capacidade privada e cuja influência cresce justamente à medida que sua presença se torna mais natural. Nesse cenário, discutir inteligência artificial com seriedade deixou de ser um exercício de curiosidade ou futurismo. Tornou-se uma necessidade crítica para qualquer pessoa que ainda queira compreender os filtros que moldam percepção, autonomia e poder no presente.

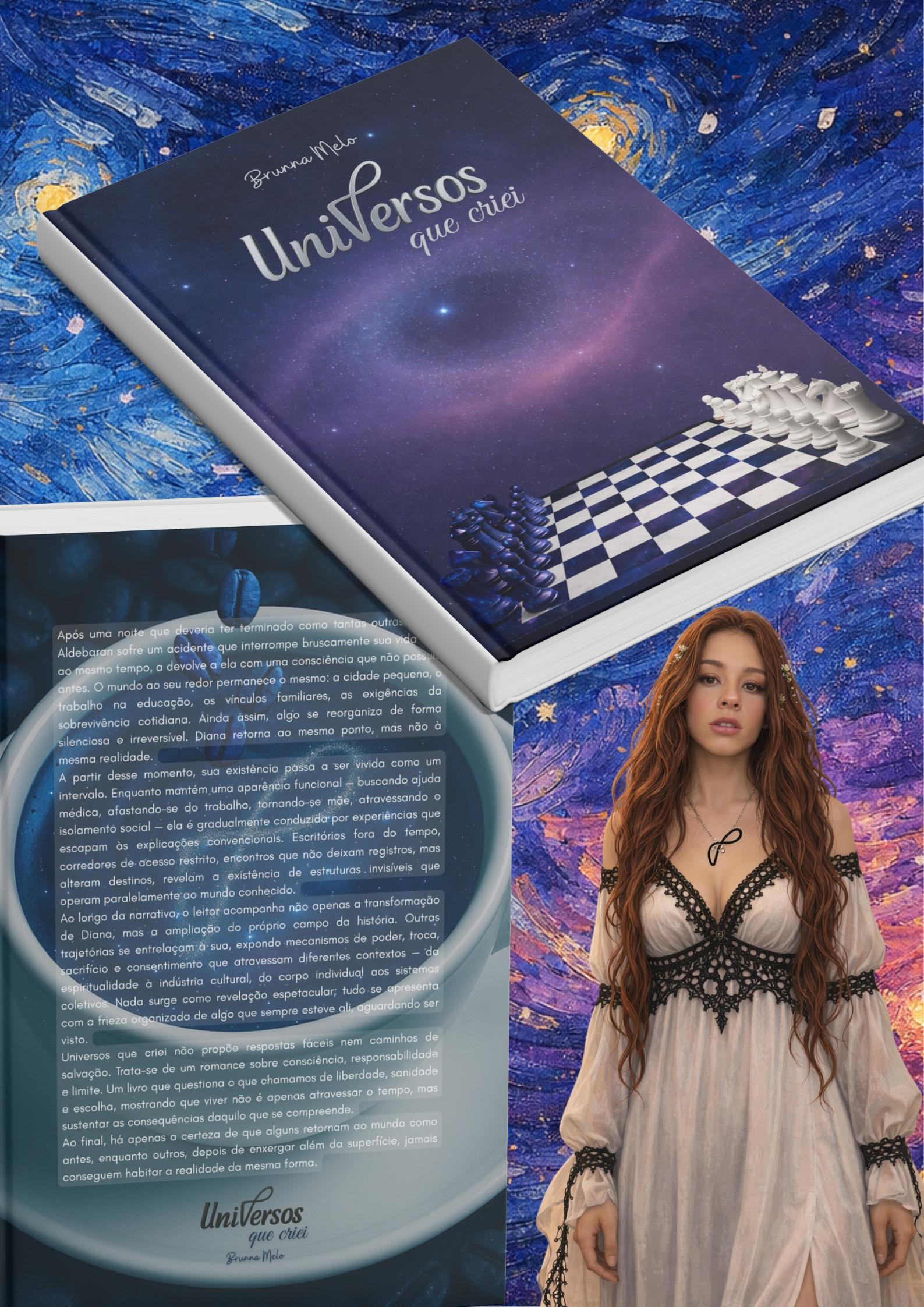

Brunna Melo — Estratégia com alma, palavra com presença

Brunna Melo é estrategista de conteúdo, revisora, copywriter e guardiã de narrativas que curam. Atuou por uma década na educação pública, onde aprendeu, na prática, que toda comunicação começa com escuta. Sua trajetória une técnica e intuição, método e magia, estrutura e sensibilidade.

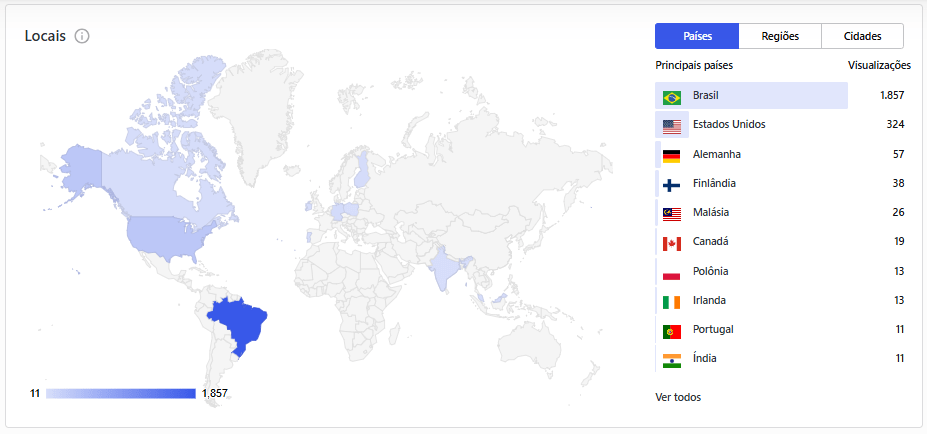

Formada em Relações Internacionais, mas também com formação técnica em Recursos Humanos e Secretariado, Brunna carrega ainda em seu percurso a pós-graduação em Diplomacia e Políticas Públicas e cursa a licenciatura em Psicopedagogia. Dos 16 aos 26 anos trabalhou na rede pública de Itapevi, onde desenvolveu um olhar atento às subjetividades, à inclusão e à palavra como ferramenta de transformação. Em 2019, realizou intercâmbio em Montreal, no Canadá, onde consolidou sua fluência em francês, inglês e espanhol, ampliando sua visão multicultural e espiritual.

Hoje, Brunna integra SEO técnico, copywriting consciente e comunicação simbólica para marcas e pessoas que desejam crescer com base, respeitando o tempo de quem lê e a verdade de quem escreve. Atua em projetos nacionais e internacionais com foco em posicionamento estratégico, revisão acadêmica, produção de conteúdo e construção de autoridade orgânica com profundidade e coerência.

Mas sua atuação vai além da técnica. Brunna é bruxa de alma antiga, com forte ligação à ancestralidade, aos ciclos e à linguagem como portal. Sua escrita é ritualística, sua presença é intuitiva e seu trabalho parte do princípio de que comunicar é também cuidar — é criar campos de confiança, abrir espaço para o sagrado e firmar digitalmente o que o corpo muitas vezes não sabe nomear.

Mãe, mulher neurodivergente, educadora e artista, Brunna transforma vivências em matéria-prima para narrativas com sentido. Seus textos não são apenas bonitos — são precisos, respeitosos, vivos. Acredita que conteúdo de verdade não serve só para engajar, mas para construir pontes, evocar arquétipos, gerar impacto real e deixar legado.

Atualmente, colabora com agências e marcas que valorizam conteúdo com presença, estratégia com alma e comunicação como campo de cura. E continua firmando um só compromisso: que toda palavra escrita esteja a serviço de algo maior.

FAQ

1. O que significa dizer que a realidade está sendo filtrada pela IA?

Significa que sistemas de IA não apenas respondem perguntas, mas resumem, priorizam, interpretam e organizam informações, influenciando o que chega ao usuário como relevante, confiável ou descartável.

2. A inteligência artificial coleta mais do que dados básicos?

Sim. Ela também aprende com padrões de uso, correções, preferências, comandos, hesitações e formas de delegação, transformando comportamento e linguagem em insumos estratégicos para aprimoramento contínuo.

3. Por que a IA não deve ser vista apenas como ferramenta?

Porque ela já atua como infraestrutura de mediação. Não apenas executa tarefas, mas interfere em escrita, busca, decisão, interpretação e acesso à informação em escala crescente.

4. Como a conveniência pode gerar dependência cognitiva?

Quando respostas prontas substituem investigação, formulação e análise próprias, o usuário se acostuma a terceirizar etapas mentais, reduzindo o exercício contínuo da autonomia intelectual e do pensamento crítico.

5. O que são programas fechados no contexto da IA?

São sistemas, testes ou iniciativas com acesso restrito, divulgação parcial e visibilidade controlada, geralmente ligados a capacidades mais sensíveis, como automação avançada, programação agentic e cibersegurança.

6. O que é capacidade privada em inteligência artificial?

É o conjunto de recursos, testes, integrações e funções conhecidas internamente por laboratórios e instituições, mas não plenamente expostas ao público em relatórios, produtos ou comunicados oficiais.

7. Qual a diferença entre capacidade pública e percepção pública?

Capacidade pública é o que já foi documentado ou apresentado. Percepção pública é o que a sociedade acredita compreender. Entre as duas, existe uma lacuna importante de informação.

8. Regulamentação significa transparência total?

Não. Regulação cria critérios, limites e categorias de risco, mas não garante acesso pleno ao funcionamento interno, aos testes sensíveis ou às capacidades privadas dos sistemas.

9. O que o artigo quer dizer com opacidade seletiva?

Que empresas e instituições divulgam apenas parte do que sabem, medem ou testam, administrando cuidadosamente a visibilidade pública sem oferecer compreensão completa sobre a tecnologia.

10. Como a IA afeta o trabalho além da automação?

Ela reorganiza a produção intelectual, redistribui autoria, altera processos de decisão e pode enfraquecer práticas cognitivas antes centrais, tornando o trabalho mais mediado por sistemas privados.

11. Por que a coleta de dados aumenta nossa vulnerabilidade?

Porque não entregamos apenas informações objetivas, mas linguagem, comportamento, padrões mentais e critérios de confiança, fortalecendo sistemas que operam com pouca transparência proporcional ao seu poder.

12. O que significa soberania cognitiva nesse contexto?

É a capacidade de pensar, interpretar, decidir e reconhecer filtros sem depender passivamente de mediações algorítmicas que organizam linguagem, percepção e acesso ao real.

13. A IA já representa risco real ou isso ainda é exagero?

O risco já é real, especialmente quando envolve automação, cibersegurança, mediação de informação e concentração de poder. O exagero costuma estar nos detalhes, não na gravidade estrutural.

14. Por que nomear programas, instituições e marcos regulatórios é importante?

Porque isso tira o debate da abstração. Nomear atores concretos ajuda a enxergar como o poder se organiza, quem regula, quem restringe e quem controla a visibilidade.

15. Qual é a principal mensagem deste artigo?

Que a inteligência artificial não transforma apenas ferramentas. Ela reorganiza mediação, percepção, trabalho e poder, enquanto a sociedade permanece mais vulnerável e menos informada do que deveria.

Deixe um comentário