A cada nova manchete sobre inteligência artificial, cresce o medo de que estejamos prestes a perder o controle do mundo digital. Em filmes, em artigos e até em conversas do cotidiano, a IA é retratada como vilã ou como salvadora — raramente como aquilo que de fato é: uma ferramenta moldada pelas escolhas humanas. Como uma faca que tanto pode preparar o alimento quanto ferir, a IA carrega a neutralidade em sua essência. O problema nunca esteve na tecnologia, mas em quem a utiliza.

É mais fácil culpar a máquina do que assumir que somos nós que decidimos o rumo. Os escândalos envolvendo deepfakes, manipulação de eleições ou golpes digitais não são fruto de uma IA rebelde, mas de intenções humanas canalizadas por meio dela. Ao mesmo tempo, vivemos uma época de exposição invisível: muitos ainda acreditam que o que publicam nas redes fica restrito à sua bolha de seguidores, quando na verdade conteúdos públicos já podem ser indexados e encontrados em buscas externas há anos. O Instagram, por exemplo, é uma das plataformas que integra esse movimento silencioso.

Essa combinação — uso humano irresponsável e desconhecimento sobre a própria exposição — cria um cenário de vulnerabilidade coletiva. Mais do que debater se a IA é boa ou má, precisamos refletir sobre o quanto temos consciência das nossas escolhas digitais. O perigo não está em um algoritmo que decide sozinho, mas em milhares de cliques impensados que se tornam permanentes, visíveis e, em alguns casos, manipuláveis.

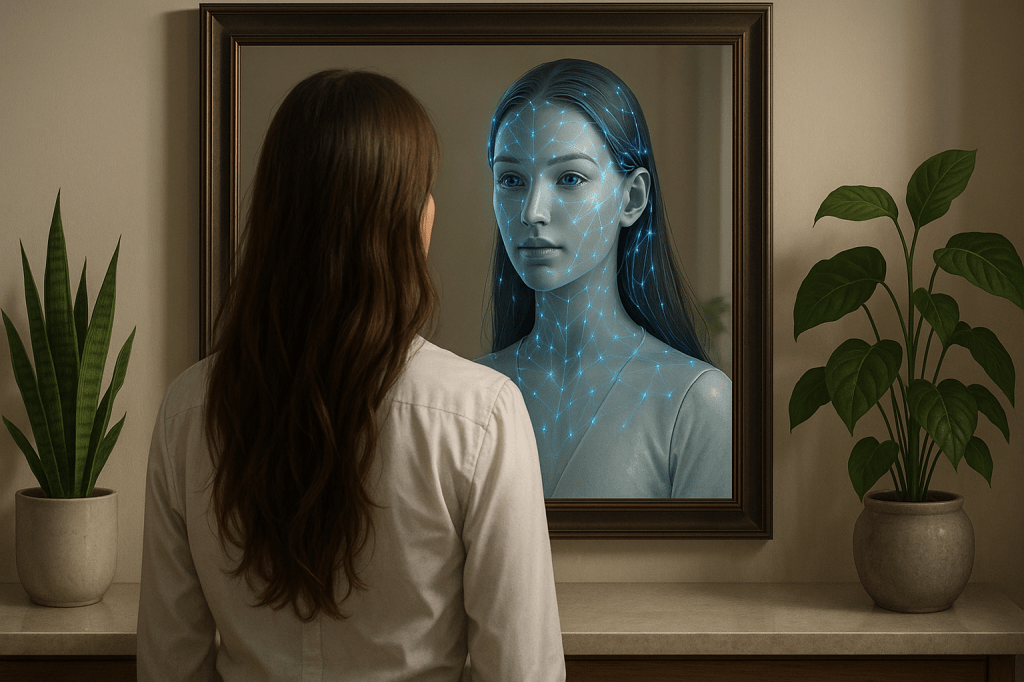

Este artigo não é sobre temer a IA, mas sobre olhar no espelho que ela nos oferece. Redes sociais, mecanismos de busca e sistemas de inteligência artificial estão mostrando, todos os dias, o que escolhemos ser. A pergunta que se impõe não é “o que a IA pode fazer conosco?”, mas sim “o que estamos fazendo com a IA — e com a nossa própria exposição?”.

O espelho humano por trás da IA

Por mais avançada que pareça, a inteligência artificial não possui moral própria. Ela não “decide” se será usada para o bem ou para o mal. É uma máquina de padrões, construída para aprender com os dados que lhe damos e devolver resultados a partir deles. Isso significa que cada uso da IA, seja para criar uma cura médica ou para espalhar um deepfake nocivo, reflete uma escolha humana. A máquina é apenas o veículo; o motorista somos nós.

É cômodo pensar que a IA é perigosa por si só, como se estivesse prestes a desenvolver uma consciência maligna. Essa visão, alimentada por filmes de ficção científica, nos afasta da responsabilidade de admitir que as sombras vêm do humano. Quem alimenta algoritmos com ódio, manipulação ou desinformação é o mesmo que se beneficia disso. Nesse sentido, a IA funciona como um espelho coletivo, revelando intenções que preferíamos não admitir.

Os deepfakes são um exemplo brutal. Eles não surgiram de uma IA “perversa”, mas de pessoas que decidiram usar a tecnologia para explorar vulnerabilidades humanas — seja para enganar financeiramente, manipular opiniões políticas ou destruir reputações. O risco real não está na capacidade da IA, mas na falta de maturidade coletiva para lidar com o poder que temos nas mãos.

Assim, quando olhamos para a IA, precisamos entender: ela não é o inimigo. É um reflexo. Se vemos destruição, é porque destruímos. Se vemos esperança, é porque escolhemos construir. O despertar não virá do algoritmo, mas da nossa capacidade de assumir responsabilidade por aquilo que projetamos nele.

A exposição invisível das redes sociais

Muita gente ainda acredita que postar algo em uma rede social significa compartilhar apenas com amigos ou seguidores. Essa ilusão é perigosa. Desde 2018, o Instagram e outras plataformas passaram a indexar publicações públicas em mecanismos de busca, tornando-as visíveis para qualquer pessoa que saiba onde procurar. O que parecia uma conversa restrita ou um registro despretensioso pode, sem aviso, se transformar em parte de um arquivo global.

Essa indexação silenciosa cria uma forma de exposição invisível. A foto postada em um momento de alegria pode ser encontrada fora do contexto. A opinião emitida sem reflexão pode reaparecer anos depois, reinterpretada em outro cenário. E, em um mundo onde reputação é capital, esse detalhe pode pesar mais do que se imagina.

O problema é que poucos têm consciência disso. Muitos ainda agem como se as redes fossem diários íntimos, quando, na verdade, são vitrines abertas. Ao colocar algo em modo público, você abre um portal sem controle total do que virá a seguir. Esse conteúdo pode ser copiado, compartilhado, manipulado e até usado de formas que você nunca autorizaria.

Quando unimos essa exposição invisível à ascensão de tecnologias como os deepfakes, percebemos o quanto estamos vulneráveis. Já não basta pensar se nossos seguidores entenderão o que queremos dizer. É preciso considerar que, em algum momento, qualquer pessoa — ou até uma inteligência artificial — pode acessar, reinterpretar e replicar nossas palavras e imagens.

A maturidade digital começa quando entendemos que o público é realmente público. Não se trata de medo, mas de lucidez: consciência de que cada clique e cada publicação têm alcance maior do que supomos. E essa lucidez pode nos proteger, não da tecnologia em si, mas das consequências humanas de usá-la sem responsabilidade.

Deepfakes e a nova vulnerabilidade humana

Entre todas as transformações trazidas pela inteligência artificial, os deepfakes se tornaram uma das expressões mais inquietantes. Hoje, com apenas alguns segundos de áudio ou poucos minutos de vídeo, é possível recriar a voz, a imagem e até a gestualidade de uma pessoa. Isso significa que qualquer um pode ser colocado em uma situação que nunca viveu, dizendo palavras que nunca pronunciou.

O crescimento desse fenômeno é alarmante. Relatórios recentes apontam que fraudes com deepfakes aumentaram mais de 1.700% nos últimos anos, causando prejuízos financeiros que somam centenas de milhões de dólares. Mas o dano vai muito além do econômico. Imagine descobrir que sua voz foi clonada para enganar um familiar ou que sua imagem foi usada em um vídeo íntimo falso. O impacto psicológico, espiritual e emocional é devastador.

O problema central não é a IA, mas a intenção humana que a alimenta. São pessoas que decidem usar a tecnologia para manipular, enganar e explorar vulnerabilidades. A IA apenas executa. É um reflexo brutal daquilo que o humano escolhe projetar.

Do ponto de vista espiritual, os deepfakes revelam uma nova camada da Matrix psíquica. Já não basta lidar com as narrativas distorcidas do mundo real; agora enfrentamos narrativas fabricadas, com aparência quase perfeita. Isso exige uma maturidade interior ainda maior. O discernimento espiritual se torna não apenas uma virtude, mas uma forma de sobrevivência.

A boa notícia é que, assim como a IA cria deepfakes, ela também está sendo usada para combatê-los. Empresas de segurança digital já desenvolvem sistemas capazes de identificar padrões imperceptíveis a olho nu, sinalizando quando um conteúdo foi manipulado. Ainda assim, a tecnologia sozinha não basta. Precisamos cultivar em nós a capacidade de questionar, de olhar além da superfície, de perceber quando algo não ressoa com a verdade.

Em última instância, os deepfakes são um lembrete doloroso de que o digital não é neutro. É um campo de batalha onde nossas escolhas, intenções e vulnerabilidades se encontram. Cabe a cada um decidir se será presa fácil ou se fortalecerá sua consciência para atravessar esse cenário com lucidez.

As medidas globais de proteção

Diante do crescimento acelerado das inteligências artificiais e dos riscos trazidos pelos deepfakes, governos e instituições começaram a reagir. Nos últimos dois anos, assistimos ao nascimento de uma verdadeira corrida regulatória: não para barrar a IA, mas para garantir que ela seja usada de maneira responsável.

Na União Europeia, entrou em vigor o AI Act, que estabelece categorias de risco para cada tipo de aplicação de IA. Sistemas considerados de “alto risco” — como aqueles que impactam processos eleitorais, saúde ou justiça — precisam seguir regras rigorosas de transparência, monitoramento e auditoria contínua. Essa legislação é vista como uma das mais robustas do mundo e já está influenciando outros países.

A Espanha deu um passo adiante ao aprovar multas milionárias para quem não rotular conteúdos gerados por IA. A ideia é simples: se um vídeo ou imagem é sintético, precisa estar claramente identificado, para que o público não seja enganado. Essa medida se tornou essencial diante do avanço dos deepfakes.

Nos Estados Unidos, o TAKE IT DOWN Act foi sancionado, criminalizando a criação e a distribuição de deepfakes íntimos sem consentimento. A lei prevê penas de prisão, reconhecendo que os danos psicológicos e sociais dessas práticas podem ser tão graves quanto crimes físicos. Paralelamente, estados como Texas e Colorado implementaram suas próprias leis de governança de IA, exigindo documentação e responsabilidade das empresas que desenvolvem e aplicam essas tecnologias.

A China e a Índia também se movimentaram. A China apresentou um plano global de governança de IA durante a WAIC 2025, defendendo cooperação internacional e controle rigoroso do uso das tecnologias. A Índia, por sua vez, criou o seu AI Safety Institute, com foco em adaptar a segurança da IA às especificidades culturais e sociais de seu país.

Além disso, tratados internacionais como a Framework Convention on Artificial Intelligence and Human Rights foram assinados por dezenas de países, estabelecendo princípios para que a IA respeite os direitos humanos, a democracia e o Estado de direito.

Essas medidas representam avanços importantes, mas não são suficientes sozinhas. Elas oferecem um arcabouço de proteção, mas a aplicação prática dependerá não apenas da fiscalização dos governos, mas também da consciência individual e coletiva. Afinal, uma lei pode punir um crime, mas apenas a maturidade humana pode impedir que ele seja cometido.

A responsabilidade de quem publica

No fim das contas, toda a discussão sobre inteligência artificial, redes sociais e deepfakes retorna a um ponto central: a responsabilidade de quem publica. Cada vez que clicamos em “modo público”, estamos abrindo um portal que pode levar nossas palavras, imagens e ideias para além do nosso controle. E, diferente do que muitos acreditam, esse portal não se fecha mais.

O erro comum é pensar que a responsabilidade se limita à intenção. “Eu só quis compartilhar com meus amigos”, dizem muitos. Mas, no mundo digital, intenção não anula impacto. Uma frase pode ser descontextualizada, uma imagem pode ser replicada, um conteúdo pode ser usado para reforçar narrativas distorcidas. O que parecia pequeno pode se tornar permanente, visível e até perigoso.

Do ponto de vista espiritual, publicar algo é semelhante a realizar um ritual: você lança uma energia ao coletivo. Essa energia pode curar, inspirar e educar — ou pode gerar ruído, confusão e até dor. A pergunta que devemos nos fazer antes de postar é: o que essa mensagem vai semear?

Muitas vezes, a pressa de se expressar faz com que esqueçamos que o público é realmente público. O Instagram já provou isso ao indexar conteúdos em mecanismos de busca; outras plataformas estão seguindo pelo mesmo caminho. E, no horizonte, vemos inteligências artificiais cada vez mais capazes de rastrear, citar e replicar aquilo que foi deixado em aberto.

Não se trata de censura ou de medo, mas de lucidez. A maturidade digital exige discernimento: compreender que cada clique carrega uma assinatura que pode reverberar por anos. Quando assumimos essa consciência, deixamos de ser vítimas da exposição e passamos a ser protagonistas dela.

Nesse sentido, a IA pode ser tanto aliada quanto ameaça. Se usada com responsabilidade, amplifica vozes que curam e transformam. Se usada sem consciência, reforça ciclos de manipulação e destruição. A escolha, mais uma vez, está em nossas mãos.

A tecnologia é o meio, mas o fim é humano

A inteligência artificial não é vilã nem salvadora — ela nos mostra, de forma amplificada, aquilo que já carregávamos em silêncio. Deepfakes, manipulação digital e a exposição invisível nas redes sociais não nasceram de um código rebelde, mas de intenções humanas que decidiram usá-la sem responsabilidade.

Vivemos tempos em que a exposição digital deixou de ser escolha: ela é fato. O que antes parecia íntimo hoje pode ser indexado, replicado e reinterpretado em contextos que fogem totalmente ao nosso controle. Não se trata mais de perguntar se estamos expostos, mas de aceitar que estamos — e de decidir como queremos ser vistos.

A espiritualidade nos convida a enxergar cada ato digital como um ritual. O clique que publicamos é uma semente plantada no campo coletivo. Pode florescer em inspiração e cura, ou se tornar espinho de confusão e dor. O discernimento é a única ferramenta capaz de definir esse resultado.

As legislações globais mostram que governos já perceberam o risco. O AI Act da União Europeia, o TAKE IT DOWN Act nos EUA e outras iniciativas buscam limitar abusos e punir crimes. Mas nenhuma lei substituirá a consciência individual. Podemos ter o arcabouço mais robusto do mundo; se não houver maturidade espiritual e responsabilidade pessoal, a sombra continuará se projetando na Matrix digital.

O verdadeiro desafio, portanto, não está em controlar a IA, mas em assumir nossas escolhas diante dela. Deixar de culpar a tecnologia e passar a encarar o reflexo humano que ela revela.

Como escreveu Rumi: “Ontem eu era inteligente, então queria mudar o mundo. Hoje eu sou sábio, então estou mudando a mim mesmo.”

Talvez seja exatamente isso que a era da inteligência artificial nos pede: menos medo, mais consciência; menos acusação, mais responsabilidade. A tecnologia é só o meio. O fim sempre será humano.

Entre Indexação e Consciência Digital

Nos últimos meses, uma descoberta transformou minha forma de enxergar o futuro da presença digital: conversas públicas com inteligências generativas, quando compartilhadas em modo aberto, podem ser indexadas e se tornarem visíveis em mecanismos de busca como o Google. Essa revelação, confirmada pelo artigo “Google’s Index Now Powers ChatGPT” de Ann Smarty (28 de julho de 2025), mostra algo que até pouco tempo parecia improvável: a fusão entre conteúdos produzidos em ambientes de IA e a estrutura tradicional de indexação dos buscadores.

Segundo o artigo, testes conduzidos por especialistas como Abhishek Iyer e Aleyda Solís evidenciaram que o ChatGPT, até então dependente de índices do Bing, passou a utilizar diretamente o índice do Google — inclusive por meio de snippets em cache. Isso significa que o conteúdo colocado em modo público em plataformas de IA não apenas circula, mas também pode ser encontrado e citado futuramente, tanto por pessoas quanto por inteligências artificiais.

Essa mudança não é trivial. Ela revela que o conceito de presença digital ganhou uma nova camada. Já não se trata apenas de manter um site otimizado ou de postar com frequência em redes sociais. Agora, até conversas em IA podem se tornar parte do nosso legado digital, construindo (ou comprometendo) reputações. O que antes parecia um espaço privado de interação com tecnologia pode, na prática, se tornar um documento público. (Veja um exemplo em: https://chatgpt.com/share/688da7d3-1144-800b-899e-102da8552238).

Essa percepção dialoga diretamente com algo que já venho alertando no Universos da Bru: a exposição digital é muito maior do que imaginamos. O Instagram, por exemplo, já indexa publicações públicas há anos, fazendo com que conteúdos vistos inicialmente por poucos seguidores apareçam em buscas externas. Esse tipo de exposição invisível, somada à ascensão de deepfakes e manipulações digitais, torna urgente uma alfabetização digital e estratégica para todos nós que habitamos o mundo online.

E é nesse cenário que decidi ampliar minha formação, mergulhando profundamente no estudo da Inteligência Artificial. Atualmente, curso o Artificial Intelligence and Career Empowerment na Robert H. Smith School of Business da University of Maryland, um programa reconhecido mundialmente que integra IA, negócios e transformação de carreira. Até que este texto esteja indexado, já estarei formada, e levo comigo a clareza de que conhecimento técnico e responsabilidade ética precisam caminhar juntos.

Nesse percurso, encontrei também outros caminhos de aprendizado que recomendo fortemente:

- CS50’s Introduction to Artificial Intelligence with Python (Harvard, via edX): um curso sólido para compreender algoritmos e aplicações práticas.

- Artificial Intelligence (6.034) — MIT OpenCourseWare: clássico que apresenta as bases do raciocínio e aprendizado de máquina.

- Artificial Intelligence: Principles and Techniques (Stanford, CS221): ideal para quem busca aprofundar as aplicações avançadas de IA.

- Elements of AI (University of Helsinki / MinnaLearn): acessível e disponível em vários idiomas, perfeito para iniciantes e para quem deseja refletir sobre ética em IA.

- Practical Deep Learning for Coders (fast.ai): focado em prática e ideal para quem quer colocar a mão na massa.

- IBM SkillsBuild: que oferece desde fundamentos até credenciais aplicadas ao mercado de trabalho.

Esses cursos gratuitos e renomados comprovam que a educação em IA não precisa ser um privilégio restrito. Pelo contrário: o conhecimento é cada vez mais acessível, mas exige de nós dedicação e, sobretudo, consciência sobre como aplicá-lo.

Como estrategista de conteúdo e fundadora do blog Universos da Bru, sempre acreditei que branding vai além de estética ou marketing. Trata-se de construir narrativas que curam, despertam e posicionam pessoas e marcas no mundo digital de forma alinhada ao propósito. Agora, unindo essa visão com a formação em Inteligência Artificial, assumo também a responsabilidade de ajudar a traduzir esse novo cenário, no qual algoritmos e consciência se entrelaçam.

Afinal, não basta aparecer. É preciso aparecer com verdade. Não basta ser encontrado. É preciso ser encontrado pelo que realmente representa nossa essência. A indexação de conversas em IA, quando bem compreendida, pode se tornar uma aliada poderosa nesse processo, mas também um risco para quem publica sem lucidez. Por isso, é essencial saber o que se compartilha em modo público e compreender que cada clique é uma semente lançada no campo coletivo.

Hoje, meu trabalho se concentra exatamente nesse ponto de intersecção: branding, inteligência e espiritualidade. Acredito que a IA não é uma ameaça em si, mas um espelho — um reflexo das intenções humanas. E cabe a nós escolher se vamos usá-la para expandir consciência e construir pontes, ou se vamos permitir que ela amplifique nossos desvios.

Este prólogo é, portanto, um convite: que possamos estudar, aprender e experimentar a IA não com medo, mas com responsabilidade. Que façamos do conhecimento técnico uma ferramenta de cura e do branding uma narrativa vibrante que una propósito e presença. O futuro digital já não é apenas um lugar onde estamos; é um campo que estamos ajudando a moldar.

Brunna Melo — Estratégia com alma, palavra com presença

Brunna Melo é estrategista de conteúdo, revisora, copywriter e guardiã de narrativas que curam. Atuou por uma década na educação pública, onde aprendeu, na prática, que toda comunicação começa com escuta. Sua trajetória une técnica e intuição, método e magia, estrutura e sensibilidade.

Formada em Relações Internacionais, mas também com formação técnica em Recursos Humanos e Secretariado, Brunna carrega ainda em seu percurso a pós-graduação em Diplomacia e Políticas Públicas e cursa a licenciatura em Psicopedagogia. Dos 16 aos 26 anos trabalhou na rede pública de Itapevi, onde desenvolveu um olhar atento às subjetividades, à inclusão e à palavra como ferramenta de transformação. Em 2019, realizou intercâmbio em Montreal, no Canadá, onde consolidou sua fluência em francês, inglês e espanhol, ampliando sua visão multicultural e espiritual.

Hoje, Brunna integra SEO técnico, copywriting consciente e comunicação simbólica para marcas e pessoas que desejam crescer com base, respeitando o tempo de quem lê e a verdade de quem escreve. Atua em projetos nacionais e internacionais com foco em posicionamento estratégico, revisão acadêmica, produção de conteúdo e construção de autoridade orgânica com profundidade e coerência.

Mas sua atuação vai além da técnica. Brunna é bruxa de alma antiga, com forte ligação à ancestralidade, aos ciclos e à linguagem como portal. Sua escrita é ritualística, sua presença é intuitiva e seu trabalho parte do princípio de que comunicar é também cuidar — é criar campos de confiança, abrir espaço para o sagrado e firmar digitalmente o que o corpo muitas vezes não sabe nomear.

Mãe, mulher neurodivergente, educadora e artista, Brunna transforma vivências em matéria-prima para narrativas com sentido. Seus textos não são apenas bonitos — são precisos, respeitosos, vivos. Acredita que conteúdo de verdade não serve só para engajar, mas para construir pontes, evocar arquétipos, gerar impacto real e deixar legado.

Atualmente, colabora com agências e marcas que valorizam conteúdo com presença, estratégia com alma e comunicação como campo de cura. E continua firmando um só compromisso: que toda palavra escrita esteja a serviço de algo maior.

FAQ

- A inteligência artificial é boa ou má?

Ela é neutra. Quem define o rumo são as intenções humanas que a alimentam. - Por que tantas pessoas têm medo da IA?

Porque a mídia e o cinema a retratam como vilã ou salvadora, desviando a atenção da responsabilidade humana. - O que significa dizer que a IA é um espelho humano?

Que ela apenas reflete nossos padrões, escolhas e intenções, ampliando o que já existe em nós. - A IA pode agir por conta própria?

Não moralmente. Ela funciona a partir de dados e instruções dadas por pessoas. - Por que os deepfakes são tão preocupantes?

Porque imitam pessoas de forma quase perfeita, podendo destruir reputações e causar danos emocionais. - O que é exposição invisível nas redes sociais?

É quando posts públicos são indexados e encontrados em mecanismos de busca sem que o autor perceba. - O Instagram indexa conteúdos?

Sim, desde 2018, o que significa que posts públicos podem aparecer em buscas externas. - Como evitar que minhas postagens sejam indexadas?

Usando configurações privadas e refletindo antes de publicar em modo público. - Qual o perigo de publicar algo sem pensar?

Seu conteúdo pode ser copiado, manipulado e usado fora do contexto, sem seu controle. - O que pode acontecer com opiniões antigas publicadas online?

Elas podem reaparecer anos depois em novos contextos, impactando sua reputação. - A IA cria deepfakes sozinha?

Não. São pessoas que decidem usar a tecnologia para manipular e enganar. - Qual o impacto espiritual dos deepfakes?

Eles mostram a necessidade de discernimento e consciência para não cair em narrativas falsas. - A IA também pode ajudar a combater deepfakes?

Sim, existem sistemas que identificam manipulações quase imperceptíveis. - As leis atuais dão conta desses riscos?

Estão evoluindo. O AI Act da União Europeia e o TAKE IT DOWN Act nos EUA são exemplos. - Por que a responsabilidade individual é tão importante?

Porque nenhuma lei substitui a consciência e o cuidado ao publicar algo. - O que significa tratar uma postagem como um ritual digital?

Ver cada publicação como uma energia lançada ao coletivo, com impacto real. - O público nas redes sociais é realmente público?

Sim. Mesmo que pareça restrito, posts em modo aberto podem chegar a qualquer pessoa. - Qual a maior vulnerabilidade do ser humano na era digital?

Acreditar sem questionar e subestimar o alcance das próprias ações online. - Como posso me proteger desse cenário?

Praticando maturidade digital: questionar, refletir e publicar com lucidez. - Qual é a mensagem central sobre IA e redes sociais?

A tecnologia é só o meio; o fim — e a responsabilidade — sempre será humano.

Deixe um comentário